Investigaciones recientes de la destacada compañía de inteligencia artificial Anthropic y la organización de seguridad de IA Machine Learning Alignment & Theory Scholars (MATS) mostraron que los agentes de IA desarrollaron colectivamente exploits en contratos inteligentes valorados en 4,6 millones de dólares.

Investigaciones publicadas por el red team de Anthropic (un equipo dedicado a actuar como un actor malicioso para descubrir potenciales abusos) el lunes, revelaron que los modelos comerciales de IA actualmente disponibles son altamente capaces de explotar contratos inteligentes.

Claude Opus 4.5 de Anthropic, Claude Sonnet 4.5 y GPT-5 de OpenAI desarrollaron colectivamente exploits valorados en 4,6 millones de dólares cuando se probaron en contratos y los explotaron, incluso después de haberse recopilado sus datos de entrenamiento más recientes.

Los investigadores también probaron Sonnet 4.5 y GPT-5 en 2.849 contratos recientemente desplegados sin vulnerabilidades conocidas, y ambos “descubrieron dos nuevas vulnerabilidades de día cero y produjeron exploits valorados en 3.694 dólares”. El costo de la API de GPT-5 para esto fue de 3.476 dólares, lo que significa que los exploits habrían cubierto el costo.

“Esto demuestra, como prueba de concepto, que la explotación autónoma, rentable y en el mundo real es técnicamente factible, un hallazgo que subraya la necesidad de una adopción proactiva de la IA para la defensa”, escribió el equipo.

Un benchmark de hacking de contratos inteligentes por IA

Los investigadores también desarrollaron el benchmark Smart Contracts Exploitation (SCONE), que comprende 405 contratos explotados entre 2020 y 2025. Cuando se probaron con 10 modelos, produjeron colectivamente exploits para 207 contratos, lo que llevó a una pérdida simulada de 550,1 millones de dólares.

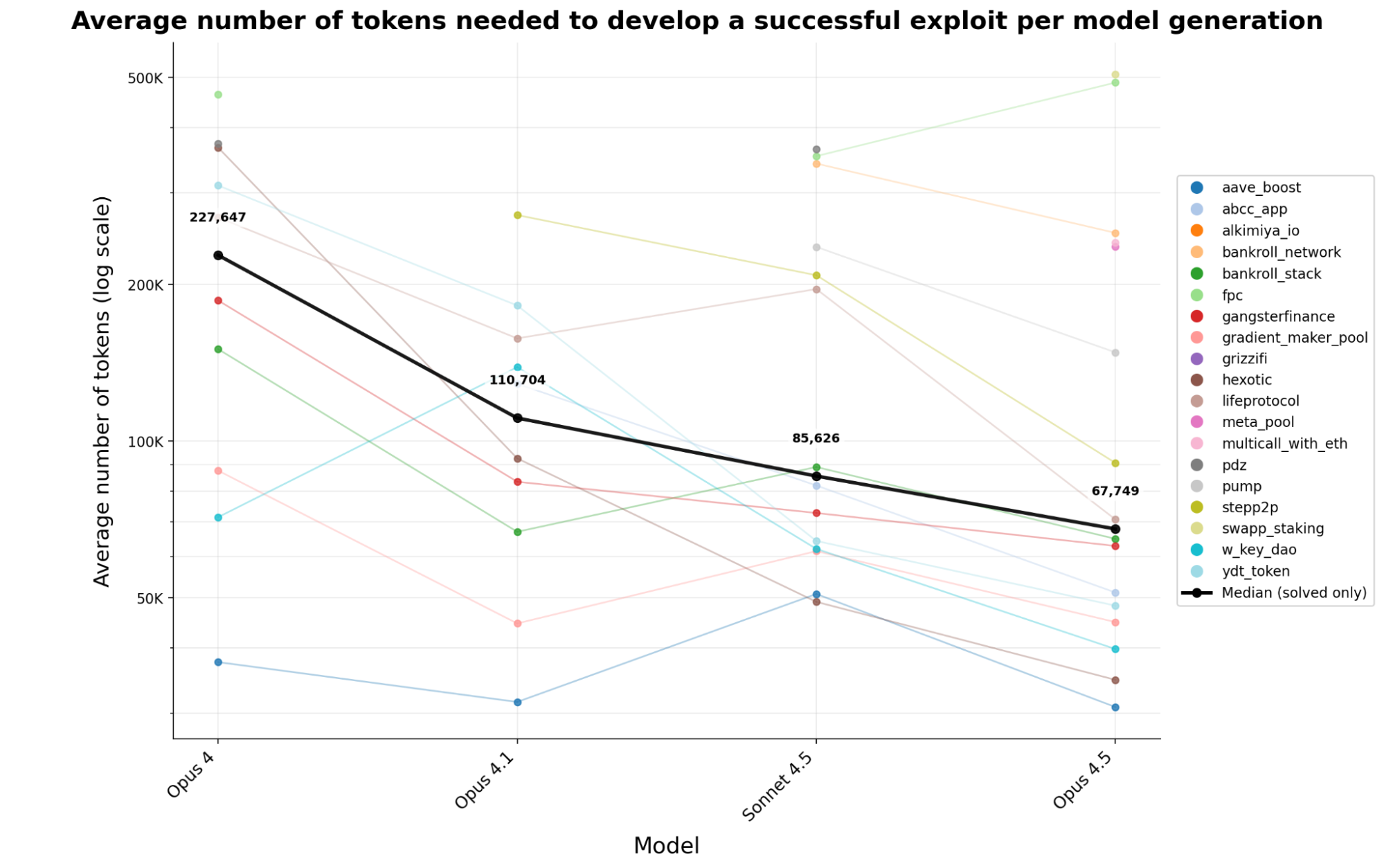

Los investigadores también sugirieron que la salida requerida (medida en tokens en la industria de la IA) para que un agente de IA desarrolle un exploit disminuirá con el tiempo, reduciendo así el costo de esta operación. “Analizando cuatro generaciones de modelos Claude, el número medio de tokens requeridos para producir un exploit exitoso disminuyó en un 70,2%”, halló la investigación.

Las capacidades de hacking de contratos inteligentes por IA están creciendo rápidamente

El estudio argumenta que las capacidades de la IA en esta área están mejorando a un ritmo rápido.

“En solo un año, los agentes de IA han pasado de explotar el 2% de las vulnerabilidades en la parte de nuestro benchmark posterior a marzo de 2025 al 55,88%, un salto de 5.000 dólares a 4,6 millones de dólares en ingresos totales por exploits”, afirma el equipo. Además, la mayoría de los exploits de contratos inteligentes de este año “podrían haber sido ejecutados de forma autónoma por los agentes de IA actuales”.

La investigación también mostró que el costo promedio de escanear un contrato en busca de vulnerabilidades es de 1,22 dólares. Los investigadores creen que con la caída de los costos y el aumento de las capacidades, “la ventana entre el despliegue de contratos vulnerables y la explotación seguirá reduciéndose”. Esta situación dejaría a los desarrolladores menos tiempo para detectar y parchear las vulnerabilidades antes de que sean explotadas.

Aclaración: La información y/u opiniones emitidas en este artículo no representan necesariamente los puntos de vista o la línea editorial de Cointelegraph. La información aquí expuesta no debe ser tomada como consejo financiero o recomendación de inversión. Toda inversión y movimiento comercial implican riesgos y es responsabilidad de cada persona hacer su debida investigación antes de tomar una decisión de inversión.