¿Cuántas veces te has encontrado con una imagen en Internet y te has preguntado: ¿Es real o es IA? ¿Alguna vez te has sentido atrapado en una realidad en la que los contenidos creados por IA y los creados por humanos se confunden? ¿Seguimos necesitando distinguir entre ellos?

La inteligencia artificial ha abierto un mundo de posibilidades creativas, pero también ha traído consigo nuevos retos, remodelando la forma en que percibimos los contenidos en Internet. Desde imágenes, música y vídeos generados por IA que inundan las redes sociales hasta deepfakes y bots que estafan a los usuarios, la IA ahora afecta a una gran parte de Internet.

Según un estudio de Graphite, la cantidad de contenido creado por IA superó al contenido creado por humanos a finales de 2024, principalmente debido al lanzamiento de ChatGPT en 2022. Otro estudio sugiere que más del 74,2% de las páginas de su muestra contenían contenido generado por IA en abril de 2025.

A medida que el contenido generado por IA se vuelve más sofisticado y casi indistinguible del trabajo realizado por humanos, la humanidad se enfrenta a una pregunta apremiante: ¿en qué medida pueden los usuarios identificar realmente lo que es real al entrar en 2026?

Aparece el cansancio por el contenido de IA: aumenta la demanda de contenido creado por humanos

Tras unos años de entusiasmo por la «magia» de la IA, los usuarios de Internet experimentan cada vez más fatiga por el contenido generado por IA, un agotamiento colectivo en respuesta al ritmo implacable de la innovación en IA.

De acuerdo con una encuesta del Pew Research Center, una media del 34% de los adultos de todo el mundo se mostraban más preocupados que entusiasmados por el aumento del uso de la IA en una encuesta realizada en la primavera de 2025, mientras que el 42% se mostraban igualmente preocupados y entusiasmados.

«La fatiga por el contenido generado por IA se ha citado en múltiples estudios, ya que la novedad de este tipo de contenido está desapareciendo poco a poco y, en su forma actual, a menudo se percibe como predecible y disponible en abundancia», explicó Adrian Ott, director de IA de EY Suiza, a Cointelegraph.

«En cierto sentido, el contenido generado por IA puede compararse con los alimentos procesados», afirmó, estableciendo un paralelismo entre la evolución de ambos fenómenos.

«Cuando apareció por primera vez, inundó el mercado. Pero con el tiempo, la gente empezó a volver a los alimentos locales y de calidad, cuyo origen conocen», explicó Ott, y añadió:

«Podría ocurrir algo similar con el contenido. Se puede argumentar que a los seres humanos les gusta saber quién está detrás de los pensamientos que leen, y una pintura no solo se juzga por su calidad, sino también por la historia que hay detrás del artista».

Ott sugirió que etiquetas como «creado por humanos» podrían surgir como señales de confianza en el contenido en línea, de forma similar a «orgánico» en los alimentos.

Gestión de contenidos generados por IA: certificación de contenidos reales entre los enfoques de trabajo

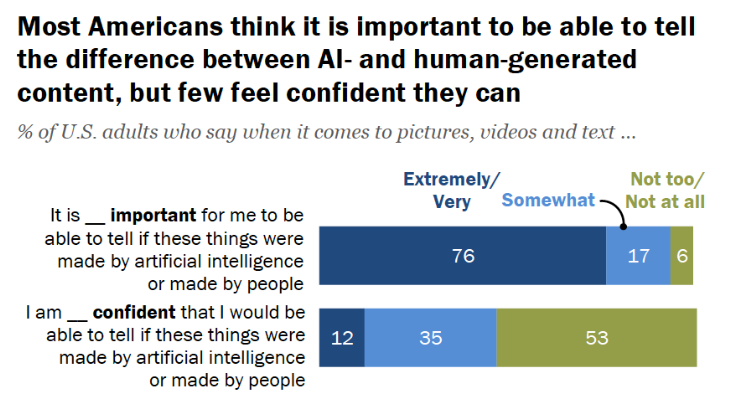

Aunque muchos pueden argumentar que la mayoría de las personas pueden detectar textos o imágenes generados por IA sin esfuerzo, la cuestión de detectar contenidos creados por IA es más complicada.

Un estudio realizado en septiembre por Pew Research reveló que al menos el 76% de los estadounidenses afirma que es importante poder detectar contenidos generados por IA, y solo el 47% confía en poder detectarlos con precisión.

«Mientras que algunas personas se dejan engañar por fotos, vídeos o noticias falsas, otras pueden negarse a creer nada en absoluto o descartar convenientemente las imágenes reales como ‘generadas por IA’ cuando no se ajustan a su narrativa», afirmó Ott, de EY, destacando los problemas de la gestión de contenidos generados por IA en línea.

Según Ott, los reguladores mundiales parecen estar avanzando hacia el etiquetado de los contenidos generados por IA, pero «siempre habrá formas de eludirlo». En su lugar, sugirió un enfoque inverso, en el que los contenidos reales se certifiquen en el momento en que se capturan, de modo que la autenticidad pueda remontarse a un evento real, en lugar de intentar detectar las falsificaciones a posteriori.

El papel de la cadena de bloques en la determinación de la «prueba de origen»

«Dado que los medios sintéticos son cada vez más difíciles de distinguir de las imágenes reales, confiar en la autenticación a posteriori ya no es eficaz», dijo Jason Crawforth, fundador y CEO de Swear, una startup que desarrolla software de autenticación de vídeos.

«La protección vendrá de sistemas que incorporen la confianza en el contenido desde el principio», afirma Crawforth, subrayando el concepto clave de Swear, que garantiza que los medios digitales sean fiables desde el momento en que se crean utilizando la tecnología blockchain.

El software de autenticación de Swear emplea un enfoque de huellas digitales basado en blockchain, en el que cada pieza de contenido se vincula a un libro mayor de blockchain para proporcionar una prueba de origen, un «ADN digital» verificable que no se puede alterar sin ser detectado.

«Cualquier modificación, por discreta que sea, se puede identificar comparando el contenido con su original verificado por blockchain en la plataforma Swear», dijo Crawforth, y añadió:

«Sin autenticidad integrada, todos los medios de comunicación, tanto del pasado como del presente, corren el riesgo de ser cuestionados […] Swear no pregunta ‘¿Es esto falso?’, sino que demuestra ‘Esto es real’. Ese cambio es lo que hace que nuestra solución sea proactiva y esté preparada para el futuro en la lucha por proteger la verdad».

Hasta ahora, la tecnología de Swear se ha utilizado entre creadores digitales y socios empresariales, centrándose principalmente en medios audiovisuales a través de dispositivos de captura de vídeo, incluidas cámaras corporales y drones.

«Aunque la integración en las redes sociales es una visión a largo plazo, nuestro enfoque actual se centra en el sector de la seguridad y la vigilancia, donde la integridad del vídeo es fundamental», afirma Crawforth.

Perspectivas para 2026: responsabilidad de las plataformas y puntos de inflexión

A medida que nos adentramos en 2026, los usuarios en línea están cada vez más preocupados por el creciente volumen de contenido generado por la IA y su capacidad para distinguir entre los medios sintéticos y los creados por humanos.

Aunque los expertos en IA hacen hincapié en la importancia de etiquetar claramente el contenido «real» frente a los medios creados por la IA, sigue sin estar claro con qué rapidez las plataformas en línea reconocerán la necesidad de dar prioridad al contenido fiable y creado por humanos, a medida que la IA sigue inundando Internet.

«En última instancia, es responsabilidad de los proveedores de plataformas proporcionar a los usuarios herramientas para filtrar el contenido generado por IA y mostrar material de alta calidad. Si no lo hacen, la gente se irá», afirmó Ott. «En este momento, no hay mucho que los individuos puedan hacer por sí mismos para eliminar el contenido generado por IA de sus feeds; ese control recae en gran medida en las plataformas».

A medida que crece la demanda de herramientas que identifiquen los medios creados por humanos, es importante reconocer que el problema fundamental no suele ser el contenido generado por IA en sí, sino las intenciones que hay detrás de su creación. Los deepfakes y la desinformación no son fenómenos totalmente nuevos, aunque la IA ha aumentado drásticamente su escala y velocidad.

Con solo un puñado de startups centradas en identificar contenido auténtico en 2025, el problema aún no ha llegado a un punto en el que las plataformas, los gobiernos o los usuarios estén tomando medidas urgentes y coordinadas.

Según Crawforth, de Swear, la humanidad aún no ha llegado al punto de inflexión en el que los medios manipulados causan un daño visible e innegable:

«Ya sea en casos legales, investigaciones, gobierno corporativo, periodismo o seguridad pública. Esperar a que llegue ese momento sería un error; las bases para la autenticidad deben sentarse ahora».

Aclaración: La información y/u opiniones emitidas en este artículo no representan necesariamente los puntos de vista o la línea editorial de Cointelegraph. La información aquí expuesta no debe ser tomada como consejo financiero o recomendación de inversión. Toda inversión y movimiento comercial implican riesgos y es responsabilidad de cada persona hacer su debida investigación antes de tomar una decisión de inversión.